Interview par Danny Turner de Future Music magazine (traduit de l’anglais).

Célèbre pour ses magnifiques concerts et l’album vendu à plusieurs millions d’exemplaires, Oxygene, de 1976, le compositeur français et pionnier de l’électronique Jean-Michel Jarre va toujours aussi fort. Ayant étudié avec le musicologue visionnaire Pierre Schaeffer dans les années 50, Jarre a un point de vue unique et fascinant sur l’histoire de la musique électronique, et a poursuivi cet héritage de l’expérimentation tout au long d’une carrière de cinq décennies. Cette année, Jarre révèle « Electronica« , un énorme projet qui le voit unir ses forces avec une armée de collaborateurs dont les incursions dans la musique électronique ont joué un rôle inspirant. Le premier album, « Electronica 1 : The Time Machine« , sort cet automne, avec un deuxième volume à suivre en Avril 2016. Pendant ce temps, Jarre a l’intention de prendre la route pour un live spectaculaire.

FM : Vous souvenez-vous avoir croisé votre premier synthétiseur ?

Jean-Michel Jarre : Oui, effectivement le véritable choc que j’ai eu a été mon premier contact avec la musique électroacoustique quand j’étais adolescent. Je suis allé travailler dans un studio à Paris dirigé par l’une des figures majeures de la musique électronique à ses origines, Pierre Schaeffer. Je me souviens de mon premier instrument de musique électronique, parce que je l’ai ici. Ca s’appelle le Coupigny GRM et je l’ai utilisé récemment dans un morceau que j’ai fait avec Air. Pour moi, c’était tellement excitant d’aborder la musique pour la première fois, pas en termes de notes, mais en termes de sons. Et ce que j’ai reçu de Schaeffer, de Pierre Henry et de tous ces gens qui ont créé tout ce que nous connaissons, est l’idée de traiter les sons – que je pouvais façonner ma musique, façonner les sons et mélanger les couleurs comme un peintre le ferait.

Jean-Michel Jarre : Oui, effectivement le véritable choc que j’ai eu a été mon premier contact avec la musique électroacoustique quand j’étais adolescent. Je suis allé travailler dans un studio à Paris dirigé par l’une des figures majeures de la musique électronique à ses origines, Pierre Schaeffer. Je me souviens de mon premier instrument de musique électronique, parce que je l’ai ici. Ca s’appelle le Coupigny GRM et je l’ai utilisé récemment dans un morceau que j’ai fait avec Air. Pour moi, c’était tellement excitant d’aborder la musique pour la première fois, pas en termes de notes, mais en termes de sons. Et ce que j’ai reçu de Schaeffer, de Pierre Henry et de tous ces gens qui ont créé tout ce que nous connaissons, est l’idée de traiter les sons – que je pouvais façonner ma musique, façonner les sons et mélanger les couleurs comme un peintre le ferait.

Quelle a été votre première incursion dans le monde des synthés ?

Mon premier synthé était le Putney VCS3 d’EMS, et je me souviens que c’était très symbolique pour moi. Je jouais dans des groupes de rock locaux, mais j’ai vendu ma guitare et mon ampli, je suis allé à Londres pour voir Peter Zinovieff – l’un des fondateurs de EMS, et j’ai eu mon premier synthétiseur. C’était comme un rêve devenu réalité parce que je pouvais faire ce que je voulais. Si je devais garder un seul synthé ce serait celui-ci, parce qu’il est un synthé tout à fait unique et un engin assez solide.

Mon premier synthé était le Putney VCS3 d’EMS, et je me souviens que c’était très symbolique pour moi. Je jouais dans des groupes de rock locaux, mais j’ai vendu ma guitare et mon ampli, je suis allé à Londres pour voir Peter Zinovieff – l’un des fondateurs de EMS, et j’ai eu mon premier synthétiseur. C’était comme un rêve devenu réalité parce que je pouvais faire ce que je voulais. Si je devais garder un seul synthé ce serait celui-ci, parce qu’il est un synthé tout à fait unique et un engin assez solide.

Avez-vous vu la musique électronique comme étant le futur ?

Absolument. Quand j’ai eu le VCS3 dans les mains, j’étais convaincu que la musique électronique deviendrait le principal genre de musique, parce que la musique électronique n’est pas comme le Rock ou le Punk, c’était, et c’est toujours, une nouvelle façon d’aborder la composition musicale, la production et, aujourd’hui, la distribution. Lorsque le Moog, le Moog System 55 et le VCS3 sont sortis, on se disait, c’est « 2001 Odyssée de l’espace » ou de la science-fiction d’Arthur C. Clarke, où les gens vous donnent une vision de l’avenir. Mais après 2000, nous avons soudainement perdu notre espoir vis-à-vis du futur. Je pense que, au début du 21e siècle, nous devons réinventer le futur. Si vous prenez l’industrie du cinéma, la vision aujourd’hui est de prendre des personnages Marvel et de les mettre dans le futur. C’est étrange que tous nos paramètres ne tendent pas vers l’avenir, mais vers le passé, comme si nous en avions un peu peur.

Absolument. Quand j’ai eu le VCS3 dans les mains, j’étais convaincu que la musique électronique deviendrait le principal genre de musique, parce que la musique électronique n’est pas comme le Rock ou le Punk, c’était, et c’est toujours, une nouvelle façon d’aborder la composition musicale, la production et, aujourd’hui, la distribution. Lorsque le Moog, le Moog System 55 et le VCS3 sont sortis, on se disait, c’est « 2001 Odyssée de l’espace » ou de la science-fiction d’Arthur C. Clarke, où les gens vous donnent une vision de l’avenir. Mais après 2000, nous avons soudainement perdu notre espoir vis-à-vis du futur. Je pense que, au début du 21e siècle, nous devons réinventer le futur. Si vous prenez l’industrie du cinéma, la vision aujourd’hui est de prendre des personnages Marvel et de les mettre dans le futur. C’est étrange que tous nos paramètres ne tendent pas vers l’avenir, mais vers le passé, comme si nous en avions un peu peur.

Lorsque la synthpop a explosé en 1979, tout le monde faisait des chansons pop avec des paroles – n’avez-vous jamais envisagé de vous adapter à ce style de musique ?

Quand la pop ou le rock électronique ont commencé au Royaume-Uni, c’est par les chansons pop ou rock, alors qu’en Europe continentale, ça a été beaucoup plus lié à la musique traditionnelle instrumentale ; des longs morceaux sans paroles et plus dans la tradition de la musique classique. La différence que je voudrais faire entre des gens comme Tangerine Dream, Kraftwerk et moi c’est que, en Allemagne, les gens avaient une approche très froide, robotique de la technologie. Tangerine Dream quittait la scène à la fin de leurs concerts et laisser les séquenceurs travailler tout seuls ; une déclaration pour dire que les machines sont le concept prédéterminant. J’ai toujours eu une approche plus impressionniste du son, venant de Ravel et de Debussy. Quand j’ai fait Oxygène, j’étais obsédé qu’aucun son ne soit exactement le même ; vous mourriez si votre rythme était identique à un autre. J’étais plus intéressé d’essayer de créer un lien entre la musique expérimentale et la pop, mais sans paroles. J’ai toujours pensé que la musique est la forme d’art la plus interactive, alors pourquoi donner une image précise à votre musique ? Par exemple, deux d’entre nous dans cette salle écoutent le même morceau de musique, mais nous avons différentes images en tête, et j’adore ce type d’interaction avec la musique.

Quand la pop ou le rock électronique ont commencé au Royaume-Uni, c’est par les chansons pop ou rock, alors qu’en Europe continentale, ça a été beaucoup plus lié à la musique traditionnelle instrumentale ; des longs morceaux sans paroles et plus dans la tradition de la musique classique. La différence que je voudrais faire entre des gens comme Tangerine Dream, Kraftwerk et moi c’est que, en Allemagne, les gens avaient une approche très froide, robotique de la technologie. Tangerine Dream quittait la scène à la fin de leurs concerts et laisser les séquenceurs travailler tout seuls ; une déclaration pour dire que les machines sont le concept prédéterminant. J’ai toujours eu une approche plus impressionniste du son, venant de Ravel et de Debussy. Quand j’ai fait Oxygène, j’étais obsédé qu’aucun son ne soit exactement le même ; vous mourriez si votre rythme était identique à un autre. J’étais plus intéressé d’essayer de créer un lien entre la musique expérimentale et la pop, mais sans paroles. J’ai toujours pensé que la musique est la forme d’art la plus interactive, alors pourquoi donner une image précise à votre musique ? Par exemple, deux d’entre nous dans cette salle écoutent le même morceau de musique, mais nous avons différentes images en tête, et j’adore ce type d’interaction avec la musique.

Lorsque la technologie numérique est arrivée, l’avez-vous embrassée avec autant d’empressement qu’avec l’analogique ?

En termes d’instruments, je pense que la musique électronique est passée par des moments difficiles. C’est lié au CD en fait – le phénomène de laisser de côté le vinyle et de penser que le CD était le Saint-Graal de la technologie, mais nous savons aujourd’hui que ce fut pire que le vinyle, et que le MP3 est pire que le CD, qui était le 78T de l’ère numérique. C’est la même chose avec les instruments numériques japonais. Lorsque le Yamaha DX7 est sorti, tout le monde pensait que c’était l’avenir et que les instruments analogiques étaient derrière nous. Tout le monde a dit que c’était génial, parce que vous aviez des presets, vous pouviez faire ce que vous vouliez, mais vous n’étiez pas aussi libre de créer les sons que vous vouliez de façon intuitive. Le numérique a passé 15 à 20 ans à essayer de rivaliser avec la chaleur et le son de l’analogique, mais seulement depuis ces cinq dernières années avec les plug-ins comme Diva, Dune, Monard, Omnisphere et ceux de Native Instruments, il y a une réelle nouvelle façon de rivaliser avec l’analogique Moog, Memorymoog ou ARP 2600.

En termes d’instruments, je pense que la musique électronique est passée par des moments difficiles. C’est lié au CD en fait – le phénomène de laisser de côté le vinyle et de penser que le CD était le Saint-Graal de la technologie, mais nous savons aujourd’hui que ce fut pire que le vinyle, et que le MP3 est pire que le CD, qui était le 78T de l’ère numérique. C’est la même chose avec les instruments numériques japonais. Lorsque le Yamaha DX7 est sorti, tout le monde pensait que c’était l’avenir et que les instruments analogiques étaient derrière nous. Tout le monde a dit que c’était génial, parce que vous aviez des presets, vous pouviez faire ce que vous vouliez, mais vous n’étiez pas aussi libre de créer les sons que vous vouliez de façon intuitive. Le numérique a passé 15 à 20 ans à essayer de rivaliser avec la chaleur et le son de l’analogique, mais seulement depuis ces cinq dernières années avec les plug-ins comme Diva, Dune, Monard, Omnisphere et ceux de Native Instruments, il y a une réelle nouvelle façon de rivaliser avec l’analogique Moog, Memorymoog ou ARP 2600.

De quelle manière les plug-ins sont-ils en concurrence avec l’analogique, sinon en les reproduisant simplement ?

Je pense que le cerveau humain est un produit chimique fantastique, mais vous pouvez le tromper. Comme pour le cinéma vous voyez une image en mouvement à 24 ou 25 images par seconde, alors qu’en fait c’est une série de clichés qui vont si vite, que vous sentez que c’est un mouvement, bien que ça n’en soit pas. C’est exactement la même chose avec le numérique ; nous avons maintenant tellement de uns et de zéros que le cerveau humain peut à peine faire la différence. J’ai longtemps pensé exactement ce que vous pensez, ceci parce que l’électricité passe par des choses que vous ne pouvez pas remplacer. C’est vrai et ce sera toujours vrai, mais pourquoi voulez-vous nécessairement faire pareil ? C’est drôle comment, pour le marketing et la nostalgie, toutes les interfaces de plug-ins essayent d’imiter les instruments vintage, mais maintenant je pense qu’il est temps d’avoir quelque chose d’autre.

En termes de logiciel numérique, vous avez été cité disant « l’absence de limite est très dangereuse ». Pouvez-vous nous en dire plus ?

Absolument. Je pense que toute forme d’art est faite de limites. Dans les années 50 la vitesse du 78T signifiait que vous ne pouviez avoir que des chansons d’Elvis Presley de trois minutes, de sorte que le format single a été créé. Lorsque les 33T sont arrivés, des gens comme Pink Floyd ou moi-même avons pu faire un morceau de musique de 20 minutes. Maintenant, à cause du plug-in Massive de Native Instruments, Skrillex et Dubstep existent. Donc, la technologie dicte le style, et non l’inverse. Mon conseil à un débutant serait de choisir un plug-in que vous aimez et, comme un exercice, de s’en contenter pendant six mois. N’explorez pas autre chose, mais explorez-le au maximum et vous verrez comment vous pouvez vous exprimer d’une façon aussi efficace.

Vous êtes-vous limité délibérément ?

J’avais seulement le VCS 3, le synthétiseur Eminent, un Solina ARP, le RMI Harmonic Synthesizer et un Korg Minipops, c’est tout – et un ARP 2600. Je veux dire que vous pourriez passer toute une vie avec cela, mais le danger aujourd’hui est que, depuis le début de cette conversation, 100 nouveaux plug-ins sont probablement disponibles sur internet, et qu’à la fin de la journée ils seront l’histoire parce qu’ils seront remplacés par 500 autres. Cette sorte de vertige que le marché crée génère l’idée que vous êtes toujours en retard avec la technologie, mais à la fin, la seule chose intéressante que vous pouvez faire va venir de vous-même, et non pas des instruments que vous utilisez.

J’avais seulement le VCS 3, le synthétiseur Eminent, un Solina ARP, le RMI Harmonic Synthesizer et un Korg Minipops, c’est tout – et un ARP 2600. Je veux dire que vous pourriez passer toute une vie avec cela, mais le danger aujourd’hui est que, depuis le début de cette conversation, 100 nouveaux plug-ins sont probablement disponibles sur internet, et qu’à la fin de la journée ils seront l’histoire parce qu’ils seront remplacés par 500 autres. Cette sorte de vertige que le marché crée génère l’idée que vous êtes toujours en retard avec la technologie, mais à la fin, la seule chose intéressante que vous pouvez faire va venir de vous-même, et non pas des instruments que vous utilisez.

Lorsque vous avez écrit Aero en 2004, c’était la première fois que quelqu’un avait sorti un album pour systèmes Surround 5.1. Est-ce que ça a marché ?

Je pense que ce projet est l’un des rares albums à avoir été conçus à l’origine en 5.1, parce que vous avez beaucoup de choses en 5.1 qui proviennent essentiellement de stems stéréo et transformés plus tard dans la phase finale du mixage. Je me suis vraiment investi dans les systèmes 5.1 dès le début, et ça a été un bon exercice pour moi parce que je ne pouvais même pas trouver un ingénieur du son capable de mixer ce que j’avais en tête. Mais personne n’est intéressé d’acquérir un 5.1 à la maison pour une raison très simple – le 5.1 fonctionne lorsque vous êtes au milieu, alors que quelqu’un est rarement assis au milieu d’une pièce. C’est comme la 3D. J’étais l’un des premiers à faire des concerts en 3D, mais maintenant je ne peux pas supporter la 3D dans les salles de cinéma. Le fait que vous avez besoin de lunettes signifie que vous perdez 60% de la lumière. La vraie 3D pour les films sera quand vous n’aurez plus d’équipement.

Je pense que ce projet est l’un des rares albums à avoir été conçus à l’origine en 5.1, parce que vous avez beaucoup de choses en 5.1 qui proviennent essentiellement de stems stéréo et transformés plus tard dans la phase finale du mixage. Je me suis vraiment investi dans les systèmes 5.1 dès le début, et ça a été un bon exercice pour moi parce que je ne pouvais même pas trouver un ingénieur du son capable de mixer ce que j’avais en tête. Mais personne n’est intéressé d’acquérir un 5.1 à la maison pour une raison très simple – le 5.1 fonctionne lorsque vous êtes au milieu, alors que quelqu’un est rarement assis au milieu d’une pièce. C’est comme la 3D. J’étais l’un des premiers à faire des concerts en 3D, mais maintenant je ne peux pas supporter la 3D dans les salles de cinéma. Le fait que vous avez besoin de lunettes signifie que vous perdez 60% de la lumière. La vraie 3D pour les films sera quand vous n’aurez plus d’équipement.

Expérimentez-vous toujours en 5.1 ?

Pour mon nouvel album, Electronica, quelques morceaux bonus seront disponibles en 3D audio. C’est en fait une nouvelle technologie sur laquelle je travaille, sans aucune application ou matériel ou sans Blu-Ray 5.1 débile que personne n’écoute de toute façon. C’est un système algorithmique complexe, où vous pouvez créer un vrai environnement surround. Je pense que c’est important parce que, quoi que l’on pense, nous sommes encore dans les âges reculés du son, en écoutant sur de minuscules haut-parleurs de notre smartphone. La haute définition n’est pas un luxe ; nous sommes nés avec des oreilles HD, donc nous devrions aussi avoir cet équipement.

Est-ce que la 3D audio changera la façon dont nous écoutons la musique ?

Du point de vue de notre environnement sonore, nous étions en mono il y a longtemps, puis un type très intelligent a inventé la stéréo dans le milieu du 20e siècle. Mais la stéréo n’est pas naturelle ; c’est un faux système avec un point progressif pour vous donner une sensation d’espace, mais ce n’est pas réellement ce que vous trouvez dans la nature. Avec cette expérience audio 3D qui accompagnera le projet, nous pouvons clairement voir la différence entre la version stéréo standard et une approche totalement différente d’écouter le son. Je voudrais vraiment développer cela afin que les jeunes producteurs et compositeurs puissent faire de la musique d’une manière totalement différente.

Electronica est votre premier album studio en huit ans. Pourquoi ce délai, et quelle était l’idéologie derrière l’album ?

Le projet est devenu beaucoup plus large que ce que je pensais et c’est la raison pour laquelle il sera un peu comme Kill Bill et Kill Bill 2, avec le second volume qui sortira en Avril 2016. Il m’a fallu beaucoup de temps pour faire ce projet parce que je voulais faire de mon prochain album studio, une véritable collaboration avec les personnes qui ont été une source d’inspiration pour moi dans le passé – des artistes qui ont été liés directement ou indirectement à la scène électronique depuis des décennies. Le concept est que nous pensons que nous sommes connectés au monde, mais nous ne parlons plus à notre voisin. Je voulais quelque chose qui était à l’opposé de la façon à la mode qui consiste à envoyer des fichiers de l’autre côté du monde sans même parler à l’autre type qui va poser une voix ou une basse. Avec l’idée de se rendre physiquement partout dans le monde pour rencontrer les gens, j’ai réalisé que, en tant que musiciens, nous sommes assez isolés et qu’il est très rare que vous puissiez commencer un projet de zéro ensemble.

Le projet est devenu beaucoup plus large que ce que je pensais et c’est la raison pour laquelle il sera un peu comme Kill Bill et Kill Bill 2, avec le second volume qui sortira en Avril 2016. Il m’a fallu beaucoup de temps pour faire ce projet parce que je voulais faire de mon prochain album studio, une véritable collaboration avec les personnes qui ont été une source d’inspiration pour moi dans le passé – des artistes qui ont été liés directement ou indirectement à la scène électronique depuis des décennies. Le concept est que nous pensons que nous sommes connectés au monde, mais nous ne parlons plus à notre voisin. Je voulais quelque chose qui était à l’opposé de la façon à la mode qui consiste à envoyer des fichiers de l’autre côté du monde sans même parler à l’autre type qui va poser une voix ou une basse. Avec l’idée de se rendre physiquement partout dans le monde pour rencontrer les gens, j’ai réalisé que, en tant que musiciens, nous sommes assez isolés et qu’il est très rare que vous puissiez commencer un projet de zéro ensemble.

Qui sont les artistes avec qui vous avez fait équipe lors de vos voyages ?

Je me suis rendu en Allemagne pour rencontrer Tangerine Dream, j’ai pris une voiture à Berlin pour rencontrer Boys Noize, à Londres pour rencontrer Pete Townshend, Fuck Buttons et Little Boots, Bristol pour rencontrer Massive Attack, Brooklyn pour rencontrer Vince Clarke, et Los Angeles pour rencontrer des gens comme Moby, David Lynch et John Carpenter. C’était vraiment d’essayer de se connecter d’une manière différente, de partager des émotions et des expériences dans le studio, comme à Paris avec Air, qui est également venu dans mon studio ici. Je ne savais pas si les gens accepteraient, mais ils ont tous dit oui.

Je me suis rendu en Allemagne pour rencontrer Tangerine Dream, j’ai pris une voiture à Berlin pour rencontrer Boys Noize, à Londres pour rencontrer Pete Townshend, Fuck Buttons et Little Boots, Bristol pour rencontrer Massive Attack, Brooklyn pour rencontrer Vince Clarke, et Los Angeles pour rencontrer des gens comme Moby, David Lynch et John Carpenter. C’était vraiment d’essayer de se connecter d’une manière différente, de partager des émotions et des expériences dans le studio, comme à Paris avec Air, qui est également venu dans mon studio ici. Je ne savais pas si les gens accepteraient, mais ils ont tous dit oui.

Comment avez-vous abordé la composition ?

Avant d’aller rencontrer les gens, j’ai composé une démo en pensant à la collaboration et ce qu’ils pourraient ajouter, mais aussi en leur laissant suffisamment d’espace pour compléter le morceau. En regardant en arrière, je suis assez étonné de la façon dont ils ont été très respectueux de ce que je leur ai donné, en essayant d’aller vraiment dans le concept comme une expérience pour eux. Dans certains cas, nous avons changé le morceau entièrement. Par exemple, avec Robert Del Naja de Massive Attack, il était assez pressé, mais pendant des mois nous n’allions nulle part. Donc, soudain, j’ai dit « OK, nous sommes sur la mauvaise voie » et j’ai fait quelque chose de tout à fait différent, et c’était ça, nous avons terminé le morceau très rapidement.

Avant d’aller rencontrer les gens, j’ai composé une démo en pensant à la collaboration et ce qu’ils pourraient ajouter, mais aussi en leur laissant suffisamment d’espace pour compléter le morceau. En regardant en arrière, je suis assez étonné de la façon dont ils ont été très respectueux de ce que je leur ai donné, en essayant d’aller vraiment dans le concept comme une expérience pour eux. Dans certains cas, nous avons changé le morceau entièrement. Par exemple, avec Robert Del Naja de Massive Attack, il était assez pressé, mais pendant des mois nous n’allions nulle part. Donc, soudain, j’ai dit « OK, nous sommes sur la mauvaise voie » et j’ai fait quelque chose de tout à fait différent, et c’était ça, nous avons terminé le morceau très rapidement.

Pour le processus du mixage, c’était un croisement de technologies ou vous avez tout fini vous-même ?

J’ai mixé une grande partie à Los Angeles dans les studios Paramount et aussi à Paris. J’étais très soucieux que, au final, ce serait un album de Jean-Michel Jarre, alors comment pouvais-je créer une unité entre le travail de Massive Attack, de Pete Townshend, de Little Boots, de Fuck Buttons ou de Air ? Tous ces collaborateurs ont un son immédiatement reconnaissable. Vous écoutez 30 secondes de Moby et vous savez que c’est Moby. J’étais en studio avec lui et il jouait un simple mi mineur – trois notes que tout le monde peut faire – et c’était Moby ; et il m’a dit que c’était la même choses quand je jouais certains accords. J’ai commencé avec Pro Tools, mais parfois j’avais 90 ou 100 pistes, ce qui a créé quelques difficultés. Donc j’ai du essayer et faire moins parce que, comme nous le savons, moins c’est plus.

J’ai mixé une grande partie à Los Angeles dans les studios Paramount et aussi à Paris. J’étais très soucieux que, au final, ce serait un album de Jean-Michel Jarre, alors comment pouvais-je créer une unité entre le travail de Massive Attack, de Pete Townshend, de Little Boots, de Fuck Buttons ou de Air ? Tous ces collaborateurs ont un son immédiatement reconnaissable. Vous écoutez 30 secondes de Moby et vous savez que c’est Moby. J’étais en studio avec lui et il jouait un simple mi mineur – trois notes que tout le monde peut faire – et c’était Moby ; et il m’a dit que c’était la même choses quand je jouais certains accords. J’ai commencé avec Pro Tools, mais parfois j’avais 90 ou 100 pistes, ce qui a créé quelques difficultés. Donc j’ai du essayer et faire moins parce que, comme nous le savons, moins c’est plus.

Quelle est la raison pour laquelle vous avez choisit d’utiliser Ableton pour réaliser le projet ?

Oui, parce que je pense qu’aujourd’hui, c’est le meilleur pour ce que je veux atteindre. J’en ai eu vraiment marre de Pro Tools ; beaucoup de studios se plaignent que l’entretien coûte plus cher que l’entretien du reste du studio, et le fait qu’il est lourd. Ce que j’aimais tellement avec Ableton Live 8 c’est qu’il est vraiment pour les DJ, mais en termes de qualité audio, Ableton 9 est l’un des meilleurs pour le son DAW comme on en a jamais entendu. Quand vous faites un bounce sur Pro Tools, vous perdez quelque chose, mais absolument rien sur Ableton Live si vous connaissez un ou deux trucs. Et aussi pour la souplesse ; quand je voyageais, je faisais tout sur un MacBook avec un lecteur 1 téraoctet et deux disques durs externes 1 téraoctet SSD et c’était parfait.

Utilisez-vous Ableton seulement comme un séquenceur ou utilisez-vous les logiciels plug-ins et VSTs ?

Je suis un grand fan des VSTs de Live. J’utilise aussi un grand nombre d’autres appareils audio et VSTs en dehors de Ableton Live – et vous pouvez dire que l’apparence d’Ableton n’est pas la plus sexy au monde, mais ils fonctionnent très bien. Même par rapport à des plug-ins d’autres sociétés, le compresseur Glue est super et la reverb et EQ est super, et pas trop gourmand en termes de CPU. Je les ai beaucoup utilisés dans le mixage, le traitement et même dans la production.

Mixez-vous sur une console SSL, et non pas « in the box » ?

C’est une question très intéressante parce que j’ai commencé à utiliser beaucoup la SSL, mais, en cours de route, j’ai commencé à l’utiliser de moins en moins. Il y a encore dix ans, je n’aurais pas envisager d’utiliser la souris pour faire le boulot, mais sur cet album, j’ai utilisé la SSL pour l’enregistrement et certains prémixages au début, mais toutes les dernières étapes je les ai faites « in the box ».

Lorsque vous démarrez un projet, quel matériel utilisez-vous ? Vous en avez tellement …

Ce que vous voyez ici n’est pas nécessairement le matériel que je suis en train d’utiliser. J’aime changer la gamme de machines en fonction du projet et en fonction du morceau. Donc, vous pourriez revenir dans un mois et les instruments autour de moi seront assez différents. Quand je repense à ce projet – qui a été massif en termes de production, la plus grande dans laquelle je me suis impliqué de ma vie – j’ai utilisé des synthés analogiques externes et des plug-ins à parts égales.

Quels sont vos synthés analogiques préférés ?

Mes préférés sont l’ARP 2600, le Memorymoog, l’Eminent Solina, le Synthi AKS et le VCS3, et aussi le Swarmatron, qui est plus récent, mais quelque chose que j’aime vraiment. J’aime les synthés comme le Korg Micro-Preset – l’ancien, rien à voir avec le MicroKorg – et beaucoup de boites à rythmes. Dans le grand studio, j’ai un ARP 2500 et j’ai aussi utilisé le Fairlight CMI pour le projet avec Air.

Mes préférés sont l’ARP 2600, le Memorymoog, l’Eminent Solina, le Synthi AKS et le VCS3, et aussi le Swarmatron, qui est plus récent, mais quelque chose que j’aime vraiment. J’aime les synthés comme le Korg Micro-Preset – l’ancien, rien à voir avec le MicroKorg – et beaucoup de boites à rythmes. Dans le grand studio, j’ai un ARP 2500 et j’ai aussi utilisé le Fairlight CMI pour le projet avec Air.

Pourquoi êtes-vous revenu au Fairlight ?

Quand nous avons discuté, j’ai dit « OK, pourquoi ne faisons-nous pas quelque chose qui est plus qu’un morceau par Air et JMJ ? » Un morceau qui revisiterait toutes les générations d’instruments, à partir de la première façon de faire des sons comme dans les années 50, voire des tape loops. A l’époque, nous n’avions aucun séquenceur, alors pour faire une boucle, nous avons utilisé du scotch. Si vous avez 120bpm pour deux barres, vous pouvez calculer la longueur de ruban d’une croche ou d’une double croche, ajouter l’enregistrement de votre grosse caisse ou de votre caisse claire et en coupant la longueur physique de ruban faire une boucle physique, mettre un pied de micro en face de vous et appuyer sur « enregistrer ». Ca permet de jouer la boucle à l’infini et c’est ainsi que la toute première boucle a été faite. Nous avons donc commencé le morceau comme ça puis nous avons inclus le premier Moog modulaire, le premier synthé analogique monophonique, l’analogique polyphonique avec l’Elka Synthex et le Memorymoog, le Fairlight CMI et l’Emulator II d’E-mu. Ensuite, nous avons utilisé le Roland D-50, le Korg M1, certains plug-ins, et le dernier son du morceau est fait avec l’iPad. Nous n’avons pas tout dans cet ordre mais, dans le morceau, nous avons tous ces instruments, et le défi que nous avions était que tout sonne de façon cohérente.

Quand nous avons discuté, j’ai dit « OK, pourquoi ne faisons-nous pas quelque chose qui est plus qu’un morceau par Air et JMJ ? » Un morceau qui revisiterait toutes les générations d’instruments, à partir de la première façon de faire des sons comme dans les années 50, voire des tape loops. A l’époque, nous n’avions aucun séquenceur, alors pour faire une boucle, nous avons utilisé du scotch. Si vous avez 120bpm pour deux barres, vous pouvez calculer la longueur de ruban d’une croche ou d’une double croche, ajouter l’enregistrement de votre grosse caisse ou de votre caisse claire et en coupant la longueur physique de ruban faire une boucle physique, mettre un pied de micro en face de vous et appuyer sur « enregistrer ». Ca permet de jouer la boucle à l’infini et c’est ainsi que la toute première boucle a été faite. Nous avons donc commencé le morceau comme ça puis nous avons inclus le premier Moog modulaire, le premier synthé analogique monophonique, l’analogique polyphonique avec l’Elka Synthex et le Memorymoog, le Fairlight CMI et l’Emulator II d’E-mu. Ensuite, nous avons utilisé le Roland D-50, le Korg M1, certains plug-ins, et le dernier son du morceau est fait avec l’iPad. Nous n’avons pas tout dans cet ordre mais, dans le morceau, nous avons tous ces instruments, et le défi que nous avions était que tout sonne de façon cohérente.

Est-ce possible de jouer cet album en live ?

Oui, je pense sérieusement à partir en tournée l’année prochaine. Nous avons beaucoup de morceaux instrumentaux, qui ne sont pas un problème. Tangerine Dream est spécial parce que Edgar Froese est décédé il y a quelques semaines après ce morceau, ce qui fait que c’est le dernier morceau de Tangerine Dream. Un morceau comme celui-ci ou Fuck Buttons, et d’autres morceaux du deuxième album, ne sont pas un problème. Beaucoup de ces artistes utilisent aussi leurs voix comme un instrument, mais pas uniquement comme une performance chantée, donc ce n’est donc pas très difficile à faire, et certains des collaborateurs se joindront à moi sur scène quand ils le pourront.

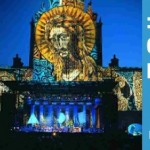

Quand vous jouez en direct devant trois millions de personnes, quelles émotions ressentez-vous – y a t-il une déconnexion ?

C’est bizarre ce que je vais dire, mais je ressens de plus en plus l’expérience de la performance comme une sorte d’histoire d’amour entre deux entités, le public et tout ce qui se passe sur scène. Parfois, il est plus intimidant d’être en face de 200 personnes que d’une grande foule dans un stade, ou même plus, car tout d’un coup ça devient juste une entité. Lorsque vous êtes dans un club avec un public restreint, vous êtes beaucoup plus exposé – mais ce n’est pas une question de déconnexion ; je pense que vous pouvez vraiment créer un lien émotionnel très fort avec une grande foule. Je me souviens du moment à Moscou quand j’ai fait ce concert devant plus de trois millions de personnes. Ce fut la nuit des funérailles de la princesse Diana, et je la connaissais et nous étions tous très affectés émotionnellement. J’avais ce morceau que je savais qu’elle aimait, donc j’ai décidé de le lui dédié et soudain la totalité de la foule, sans dire un mot, s’est mis à allumer des bougies. Moscou n’est pas Londres – c’est très loin, culturellement et géographiquement – alors de voir cette foule danser de façon incontrôlable puis s’arrêter, c’est exactement ça la magie du spectacle. C’était un tel choc émotionnel que je n’ai pas pu jouer pendant une minute. Donc, je dirais que cela peut être l’inverse de la déconnexion, tout à coup c’est une seule entité dans son ensemble, partageant le même moment émotionnellement.

C’est bizarre ce que je vais dire, mais je ressens de plus en plus l’expérience de la performance comme une sorte d’histoire d’amour entre deux entités, le public et tout ce qui se passe sur scène. Parfois, il est plus intimidant d’être en face de 200 personnes que d’une grande foule dans un stade, ou même plus, car tout d’un coup ça devient juste une entité. Lorsque vous êtes dans un club avec un public restreint, vous êtes beaucoup plus exposé – mais ce n’est pas une question de déconnexion ; je pense que vous pouvez vraiment créer un lien émotionnel très fort avec une grande foule. Je me souviens du moment à Moscou quand j’ai fait ce concert devant plus de trois millions de personnes. Ce fut la nuit des funérailles de la princesse Diana, et je la connaissais et nous étions tous très affectés émotionnellement. J’avais ce morceau que je savais qu’elle aimait, donc j’ai décidé de le lui dédié et soudain la totalité de la foule, sans dire un mot, s’est mis à allumer des bougies. Moscou n’est pas Londres – c’est très loin, culturellement et géographiquement – alors de voir cette foule danser de façon incontrôlable puis s’arrêter, c’est exactement ça la magie du spectacle. C’était un tel choc émotionnel que je n’ai pas pu jouer pendant une minute. Donc, je dirais que cela peut être l’inverse de la déconnexion, tout à coup c’est une seule entité dans son ensemble, partageant le même moment émotionnellement.

Article lu 312 fois